سباق محموم خلف الكواليس: لماذا تتسابق الشركات لإطلاق نماذجها الآن؟

نشهد هذا الأسبوع حالة من الاستنفار القصوى في مختبرات الذكاء الاصطناعي العالمية. لم يعد الأمر يتعلق بمجرد "تحديثات دورية"، بل بسباق استراتيجي للسيطرة على معيار الذهب الجديد: الذكاء الاصطناعي الوكيلي (Agentic AI) والقدرة الفائقة على البرمجة.

Qwen3-Coder-Next: ضربة البداية من علي بابا

فاجأت مجموعة Qwen (المطورة من قبل Alibaba) الجميع بإطلاق Qwen3-Coder-Next، وهو نموذج مفتوح الأوزان مصمم خصيصاً للوكلاء البرمجيين والتطوير المحلي.

ما الذي يجعل هذا النموذج استثنائياً؟

-

كفاءة مذهلة: يمتلك النموذج 80 مليار بارامتر إجمالاً، لكنه يستخدم 3 مليارات فقط (3B active) في كل عملية استنتاج، مما يجعله فائق السرعة ومناسباً للتشغيل المحلي.

-

تدريب وكيلي مكثف: تم تدريبه على 800 ألف مهمة قابلة للتحقق (Verifiable tasks) وبيئات تشغيل حقيقية، مما يقلل من احتمالية كتابة كود لا يعمل.

-

دعم المنصات المفتوحة: يدعم النموذج بشكل كامل مشاريع مثل OpenClaw و Claude Code و Cline.

خارطة الطريق: أين يقف المنافسون؟

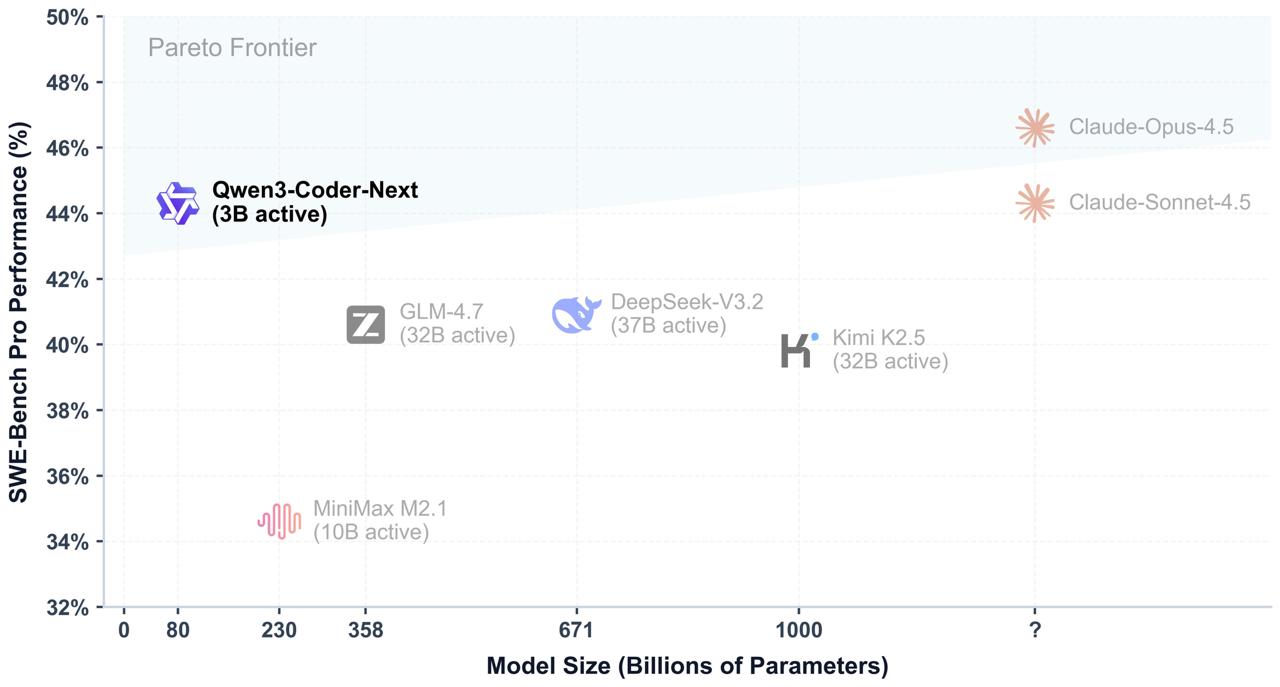

تكشف الرسوم البيانية المسربة والنتائج الرسمية على معيار SWE-Bench Pro (الذي يقيس قدرة النماذج على حل مشاكل برمجية حقيقية في مستودعات GitHub) عن خارطة طريق مرعبة:

-

عائلة Claude (Sonnet 5): تظهر النماذج المرتقبة في قمة الهرم بأداء يتجاوز 46%، وهو ما يفسر استعجال المنافسين للإعلان قبل إطلاق أنثروبيك الرسمي.

-

الزحف الصيني: نماذج مثل GLM-4.7 و DeepSeek-V3.2 و Kimi K2.5 تتقارب بشدة في الأداء (حول منطقة 40%)، مما يخلق منافسة شرسة في الفئة المتوسطة ذات الكفاءة العالية.

-

MiniMax M2.1: يثبت وجوده كلاعب قوي في النماذج الخفيفة (10B active) التي توازن بين الذكاء وسرعة التنفيذ.

لماذا هذا التوقيت؟

السر يكمن في "بيئة العمل". مع إطلاق تطبيقات مثل OpenAI Codex وتوسع Claude Code، أدركت الشركات أن من يمتلك "الموديل" الذي يفضله المبرمجون والوكلاء الآن، سيمتلك البيانات والولاء للمرحلة القادمة.

الشركات تتسابق للإعلان الآن لأنها تدرك أن Claude Sonnet 5 قد يرفع السقف إلى مستويات تجعل من الصعب على النماذج الحالية المنافسة، لذا فإن حجز مكان في "ذاكرة المطورين" قبل هذا الإطلاق هو ضرورة للبقاء.

نحن لا نعيش مجرد أسبوع من الإعلانات، بل نشهد إعادة تشكيل كاملة لمفهوم "المساعد البرمجي".

يمكن للمطورين والباحثين الحصول على مزيد من المعلومات عبر مدونة Qwen الرسمية، أو تجربة الموديل مباشرة عبر منصة Hugging Face.