إطلاق عملاق المصادر المفتوحة: GLM-5 يكسر حواجز التعقيد الهندسي بـ 744 مليار بارامتر

في قفزة تقنية هائلة هزت مجتمع المصادر المفتوحة اليوم، أعلنت شركة Z.ai (Zhipu AI) عن إطلاق نموذجها الرائد GLM-5. لا يمثل هذا النموذج مجرد تحديث دوري، بل هو محاولة صريحة لردم الفجوة تماماً مع النماذج المغلقة (Frontier Models) مثل Claude Opus و GPT-5، مع التركيز الكامل على مهام "الوكلاء الأذكياء" (Agentic Tasks).

وحش الأرقام: 744 مليار بارامتر

تم بناء GLM-5 بمعمارية ضخمة تهدف إلى رفع كفاءة الذكاء الاصطناعي العام (AGI):

-

الحجم: انتقل النموذج من 355B في الإصدار السابق إلى 744 مليار بارامتر.

-

النشاط الذكي: يعتمد تقنية MoE حيث يتم تفعيل 40 مليار بارامتر فقط (40B active) لكل طلب، مما يضمن سرعة فائقة رغم الحجم العملاق.

-

البيانات: تم تدريبه على كمية مهولة بلغت 28.5 تريليون توكن.

ابتكارات تقنية: DSA و Slime

لم تكتفِ Z.ai بزيادة الحجم، بل أدخلت تحسينات معمارية جذرية:

-

DSA (DeepSeek Sparse Attention): تم دمج تقنية الاهتمام المتناثر لتقليل تكاليف التشغيل (Deployment Cost) بشكل كبير مع الحفاظ على قدرة استيعاب السياق الطويل.

-

بنية Slime: وهي بنية تحتية جديدة للتعلم التعزيزي اللامركزي (Asynchronous RL) تسمح للنموذج بتطوير مهاراته في حل المشكلات البرمجية والمنطقية بدقة تتفوق على GLM-4.7 بمراحل.

تحليل تفصيلي للأداء مقابل العمالقة

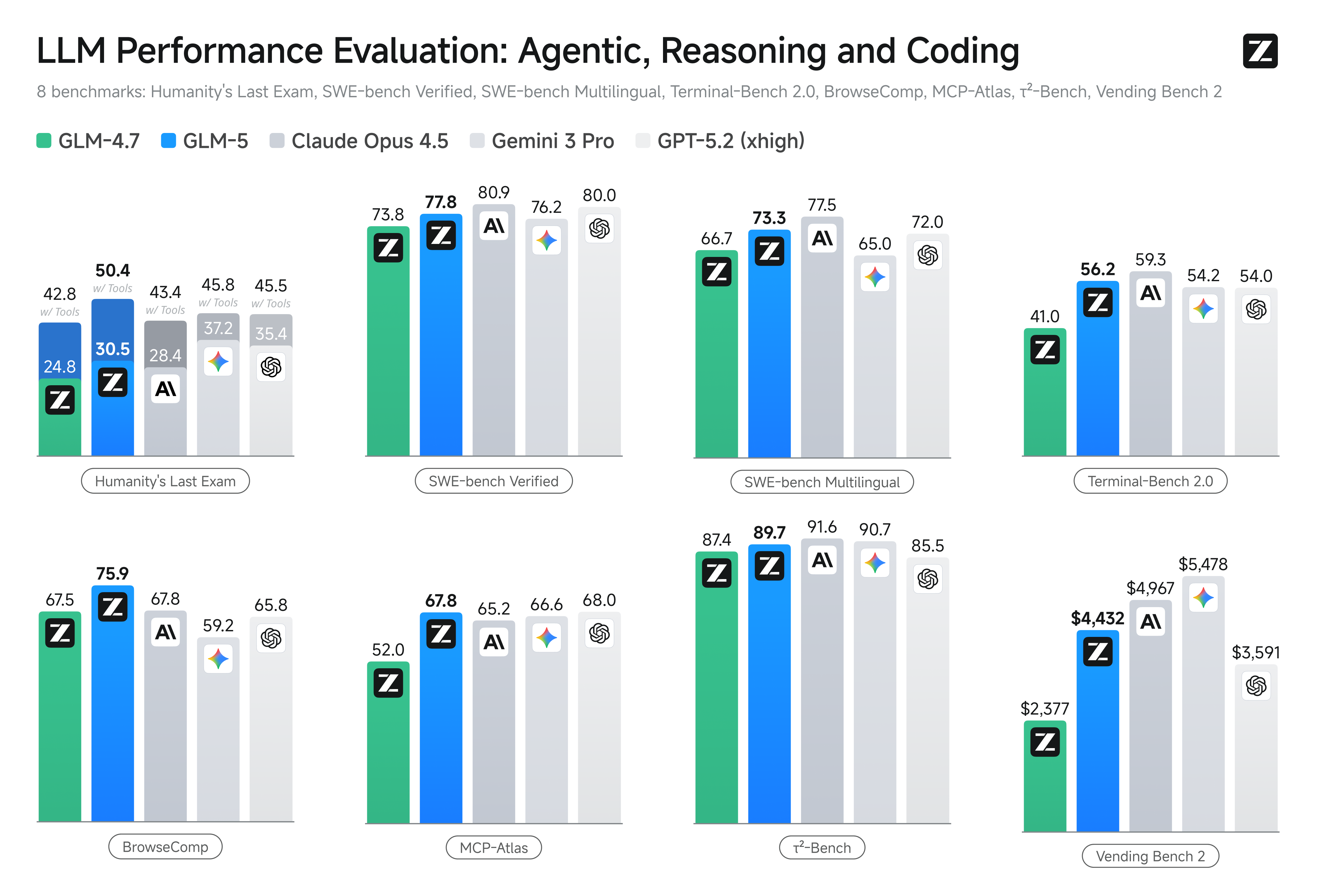

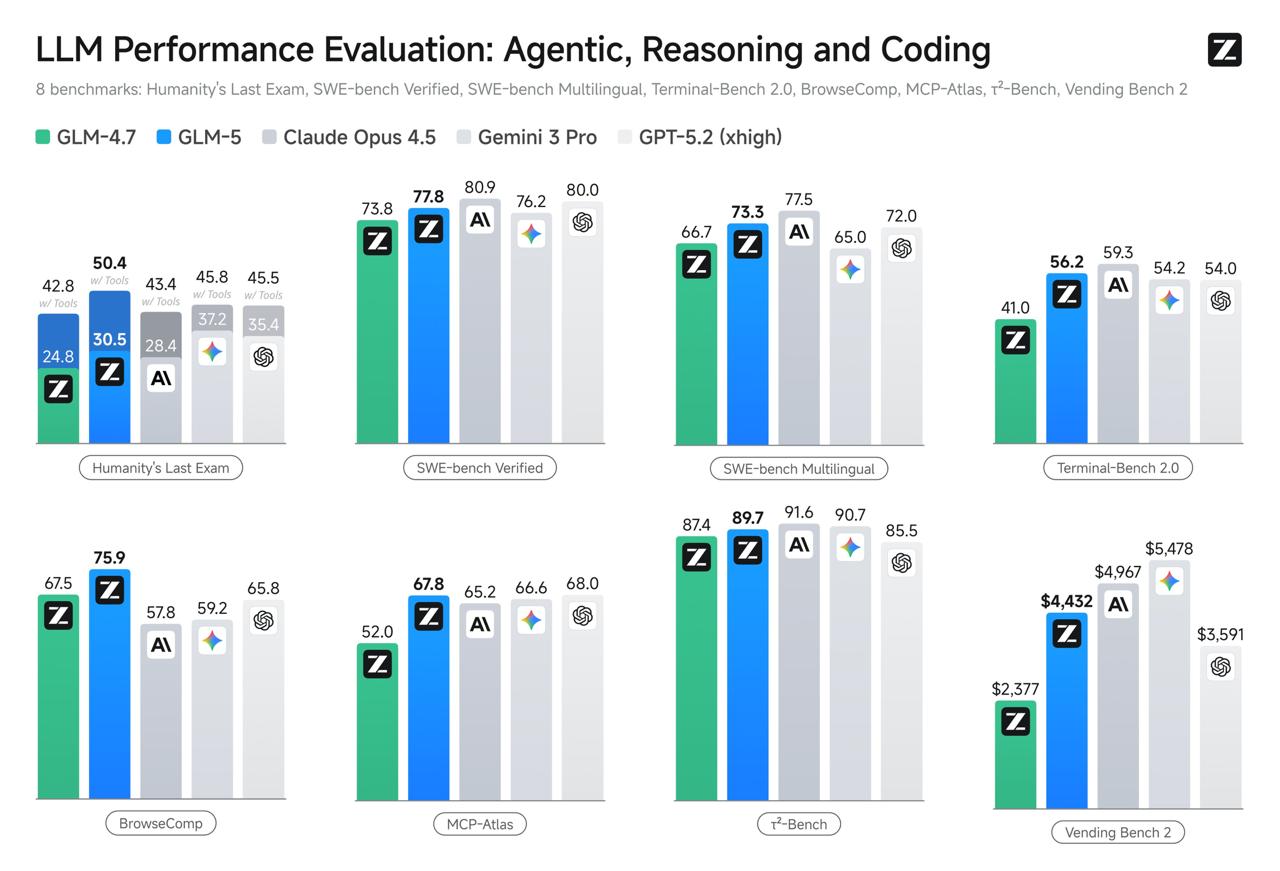

تكشف الرسوم البيانية التفصيلية التي نشرتها Z.ai عن تفوق ملحوظ لـ GLM-5 في مهام البحث الذكي والاستدلال، حيث يظهر الموديل نضجاً كبيراً في التعامل مع المهام متعددة الخطوات:

📊 جدول مقارنة الأداء الشامل

يوضح الجدول التالي موقع GLM-5 (في وضعية التفكير - Thinking) مقارنة بأقوى النماذج المتاحة حالياً في مجالات الاستدلال، البرمجة، والمهام الوكيلية:

| الاختبار المعياري (Benchmark) | GLM-5 (Thinking) | GLM-4.7 | DeepSeek V3.2 | Kimi K2.5 | Claude Opus 4.5 | Gemini 3 Pro | GPT-5.2 |

|---|---|---|---|---|---|---|---|

| Humanity's Last Exam | 30.5 | 24.8 | 25.1 | 31.5 | 28.4 | 37.2 | 35.4 |

| AIME 2026 I | 92.7 | 92.9 | 92.7 | 92.5 | 93.3 | 90.6 | - |

| GPQA-Diamond | 86.0 | 85.7 | 82.4 | 87.6 | 87.0 | 91.9 | 92.4 |

| SWE-bench Verified | 77.8 | 73.8 | 73.1 | 76.8 | 80.9 | 76.2 | 80.0 |

| Terminal-Bench 2.0 | 60.7 | 41.0 | 39.3 | 50.8 | 59.3 | 54.2 | 54.0 |

| BrowseComp | 62.0 | 52.0 | 51.4 | 60.6 | 37.0 | 37.8 | - |

| Vending Bench 2 | $4,432 | $2,376 | $1,034 | $1,198 | $4,967 | $5,478 | $3,591 |

ملاحظة: النتائج تعكس تفوق GLM-5 كأقوى نموذج مفتوح المصدر في المهام الوكيلية والبرمجية.

من "الدردشة" إلى "العمل": إنتاج المستندات مباشرة

انتقل GLM-5 بمفهوم النماذج اللغوية من مجرد نافذة شات إلى أداة إنتاجية حقيقية. يستطيع النموذج الآن تحويل النصوص والمواد الخام مباشرة إلى ملفات جاهزة للاستخدام بصيغ:

-

Microsoft Word (.docx): خطط عمل، مذكرات قانونية، ودروس تعليمية.

-

Adobe PDF: تقارير رسمية وكتيبات.

-

Microsoft Excel (.xlsx): جداول بيانات مالية، تحليلات، ونماذج إحصائية.

هذه الملفات يتم تسليمها بشكل كامل (End-to-End) دون الحاجة لتدخل بشري في التنسيق، مما يجعله مثالياً لبناء وكلاء أتمتة المكاتب.

التوافق الواسع ودعم العتاد المتنوع

أحد أهم أهداف Z.ai هو كسر احتكار العتاد؛ لذا يدعم GLM-5 التشغيل على تشكيلة واسعة من المعالجات والرقائق غير التابعة لـ NVIDIA، بما في ذلك:

-

Huawei Ascend و Moore Threads.

-

RISC-V و ARM عبر تقنيات التكميم (Quantization) المتقدمة.

-

توافق كامل مع أدوات Claude Code و OpenClaw عبر بروتوكولات MCP.

كيف تبدأ الاستخدام؟

-

للمطورين: أوزان الموديل متاحة تحت رخصة MIT على Hugging Face.

-

التشغيل المحلي: يدعم أطر العمل الشهيرة مثل vLLM و SGLang.

-

المستخدم العادي: يمكن تجربة وضع "الوكيل" (Agent Mode) مجاناً عبر chat.z.ai، حيث تتوفر مهارات إنشاء ملفات Word و Excel مباشرة.

تحليل: إطلاق GLM-5 يعني أن احتكار الشركات الكبرى للقدرات العالية في المهام الوكيلية (Agentic Workflows) قد انتهى. نحن الآن نملك نموذجاً مفتوحاً قادراً على إدارة أنظمة هندسية معقدة بذكاء يضاهي البشر وبمرونة عالية في التكلفة والعتاد.